L'intervista

giovedì 4 Maggio, 2023

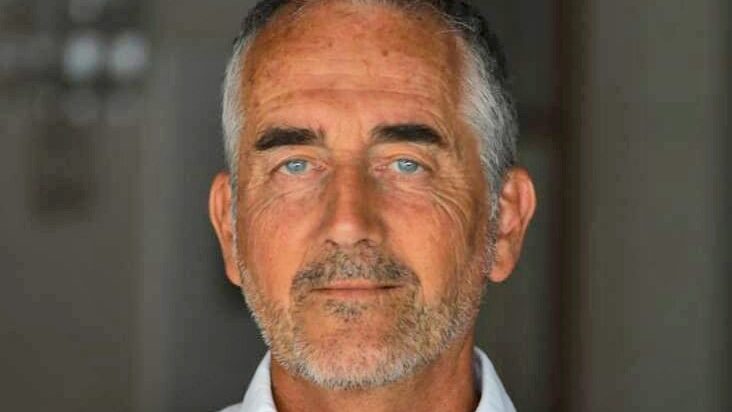

ChatGpt, parla il Garante della Privacy: «Bloccarla era inevitabile»

di Francesca Fattinger

Guido Scorza, atteso domenica a Rovereto per il Wired Next Fest, spiega: «Manca trasparenza sul trattamento dei dati personali. Ora l'istruttoria»

Guido Scorza, componente del collegio del Garante per la protezione dei dati personali, aprirà gli incontri della giornata di domenica 7 maggio del Wired Next Fest 2023, il festival dedicato a innovazione, tecnologia, scienza e cultura e che quest’anno arriva a Rovereto. Nel suo intervento spiegherà perché ChatGPT è stato bloccato da parte dell’Authority, un provvedimento ritenuto necessario «per non lasciare per diversi mesi se non per un anno esposto a un rischio troppo elevato un pubblico troppo ampio» e per dare quindi una risposta veloce e chiara.

Partiamo dal tema caldo di questi giorni che sarà al centro del suo intervento al Wired Next Fest: quali sono le motivazioni del blocco di ChatGPT? Lo stop era l’unica strada possibile?

«Stop e riapertura sono evidentemente più prossimi al calcio di inizio che non al fischio finale della partita. Ci stiamo occupando di una fase di emergenza, abbiamo cercato di ottenere la messa in sicurezza di quella soluzione di intelligenza artificiale, ma siamo molto lontani dall’aver risolto tutti i problemi di quel caso specifico, cioè del ChatGPT, e più in generale della relazione tra privacy e intelligenze digitali di tipo generativo. Stiamo però gettando le basi per risolverlo in futuro nell’ambito dell’istruttoria che abbiamo aperto al Garante in Italia nei confronti di OpenAi che gestisce ChatGPT. Il provvedimento di sospensione temporanea da cui tutto si è originato era l’unica cosa che avrebbe avuto senso fare. Avevamo davanti una società for profit che in 3 mesi o poco più si avviava a raggiungere 200 milioni di utenti in giro per il mondo, che ha avuto uno straordinario successo di pubblico anche nel nostro paese e che dal nostro punto di vista era stata poco trasparente in relazione al trattamento dei dati personali, non riconoscendo i diritti che avrebbe dovuto riconoscere in forza della disciplina europea. In un contesto di questo genere il provvedimento d’urgenza era quello a cui ricorrere per evitare un’amplificazione del rischio. Ogni giorno in cui quell’attività veniva esercitata in quelle condizioni i diritti di interessi di forse milioni di persone in Italia venivano esposti a un certo rischio. Si poteva scegliere in astratto un’altra strada, quella della sola istruttoria ordinaria, che pure abbiamo aperto, però avremo lasciato per diversi mesi se non per un anno esposto a un rischio troppo elevato un pubblico troppo ampio e non avremmo nemmeno fatto bene alla piccola e media impresa di casa nostra, lasciando un enorme punto interrogativo in termini di legittimità di quell’attività».

Viviamo in una società sempre più tecnologica e virtuale, ma sappiamo davvero poco della nostra privacy online, quali sono i rischi in cui incorriamo anche inconsapevolmente?

«I rischi sono direttamente proporzionati alle opportunità. Parliamo di smartphone, ma anche di navigatori o altri dispositivi come Alexa o Google Assistant. Ogni volta che usiamo questi dispositivi e i servizi condividiamo una quantità importante di dati personali ed esponiamo noi stessi a rischi. Permettiamo a prestatori di servizi privati di conoscerci più o meno bene. Le utilità indiscutibili che dispositivi e servizi ci mettono a disposizione li paghiamo esponendoci e cedendo dati. Il rischio principale è che chi arriva a conoscerci così bene sono le società commerciali che si celano dietro a servizi e dispositivi e che imparano a manipolare la tua libertà e il tuo diritto ad autodeterminarti. Come limitare questi rischi che restano ineliminabili? Andare in moto o in macchina è straordinariamente più veloce e comodo che andare a piedi, ma sicuramente più pericoloso. Quindi ci muniamo di casco e cintura di sicurezza per limitare i rischi non potendo azzerarli. Nella dimensione digitale accade una cosa simile. Per limitare i rischi bisogna educarsi all’uso di questi dispositivi. Porci delle domande e cercarvi risposta prima di usarli con leggerezza è sicuramente l’antidoto più efficace».

Un tema importante quando si tratta di tutela della privacy è quello dei minori che è anche un tema centrale nella sua attività. Quali misure sarebbe meglio adottare?

«Nel caso dei minori la partita diventa ancora più difficile e delicata. Le chance che un minore capisca e apprezzi il valore dei dati sono inferiori rispetto a un adulto che pure molto spesso fa fatica. Quando si parla di minori questo scambio di dati contro servizi è particolarmente iniquo e inconsapevole. Quali allora le soluzioni, oltre a una necessaria educazione all’uso dei dispositivi digitali? Innanzitutto se una piattaforma dice lei stessa che con meno di 13 anni non può essere utilizzata, bisogna rispettarne le indicazioni. Dal lato dei fornitori dei servizi però dovrebbe essere chiaro che non si può limitare a chiedere l’età, ma implementare soluzioni di age verification per verificarla effettivamente. Dal lato nostro da un po’ di tempo esigiamo dai gestori delle piattaforme che siano più rigorosi. Abbiamo bloccato per qualche settimana TikTok, perché sembrava lasciasse entrare troppi infra tredicenni e di recente anche Replika, chatbot che in qualche caso pratico si è dimostrato così socievole da dare ai minori indicazioni di carattere sessuale. Procediamo quindi in maniera episodica in attesa di mettere a sistema questo tipo di approccio».

L'intervista

Nicolò Govoni e la scuola come riscatto: «Dopo vent'anni a sentirmi fuori posto, ho trovato la mia missione: aiutiamo i bambini a cambiare il destino»

di Ilaria Bionda

Al Teatro Sociale di Trento (sold out) va in scena "L’uomo che costruiva il futuro". L'attivista nominato al Nobel per la Pace si racconta tra la fuga giovanile da Cremona e la nascita di Still I Rise